在当今人工智能领域,deepseek与gpt备受瞩目。它们代表了先进的语言模型技术,为诸多应用场景带来了变革。

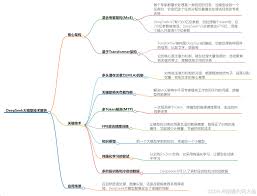

deepseek架构特点

deepseek采用了深度神经网络架构。它由多个隐藏层组成,这些隐藏层不断对输入数据进行特征提取和转换。通过大规模的数据训练,deepseek能够学习到丰富的语言模式和语义信息。其独特之处在于优化了网络结构,减少了计算资源的消耗,同时提高了模型的训练效率。这使得它能够在处理复杂的语言任务时,快速且准确地给出结果。

gpt技术架构剖析

gpt(generative pretrained transformer)则以transformer架构为核心。transformer摒弃了传统的循环神经网络,采用了自注意力机制。这种机制使得模型能够并行处理序列中的元素,捕捉到长距离的依赖关系。gpt通过在大规模文本数据上进行无监督预训练,学习到通用的语言知识,然后针对具体任务进行微调。这种预训练-微调的模式,大大提高了模型在各种自然语言处理任务上的性能。

两者对比

从架构上看,deepseek侧重于优化深度神经网络的结构本身,以提升训练和推理效率。而gpt的transformer架构的自注意力机制是其亮点,能够更好地处理长文本和复杂语义关系。在应用方面,两者都在自然语言处理任务中表现出色,如文本生成、问答系统、语言翻译等。但由于架构的差异,它们在不同任务上可能各有优劣。

技术架构对应用的影响

deepseek与gpt的技术架构为众多应用打开了新的大门。在内容创作领域,它们能够快速生成高质量的文章、故事等。在智能客服方面,能够准确理解用户问题并给出恰当回答。在教育领域,可作为智能辅导工具,帮助学生学习。这些应用的背后,是强大的技术架构在支撑,不断推动着人工智能在各个行业的落地和发展。

总之,deepseek与gpt的技术架构代表了人工智能语言模型的先进水平,它们的创新和发展为未来的智能生活带来了无限可能。